الموقع الثاني الذي دفعته روبوتات Doppelganger استهدف الألمان. في أكتوبر 2022 تحقيق للصحيفة الألمانية يموت فيلت وجدت أن مؤلف المحتوى الموجود على موقع EuroBRICS كان يتقاضى أجرًا مباشرًا من شركة InfoRos، المسجلة كمشغل لموقع EuroBRICs من قبل مسجل النطاق الألماني.

تمت أيضًا مشاركة العديد من الصور نفسها من حملة Doppelganger، إلى جانب صور أخرى تستهدف جمهورًا ناطقًا باللغة الإنجليزية، على X بواسطة نفس شبكة الروبوتات التي شاركت سابقًا روابط لحملات Doppelganger.

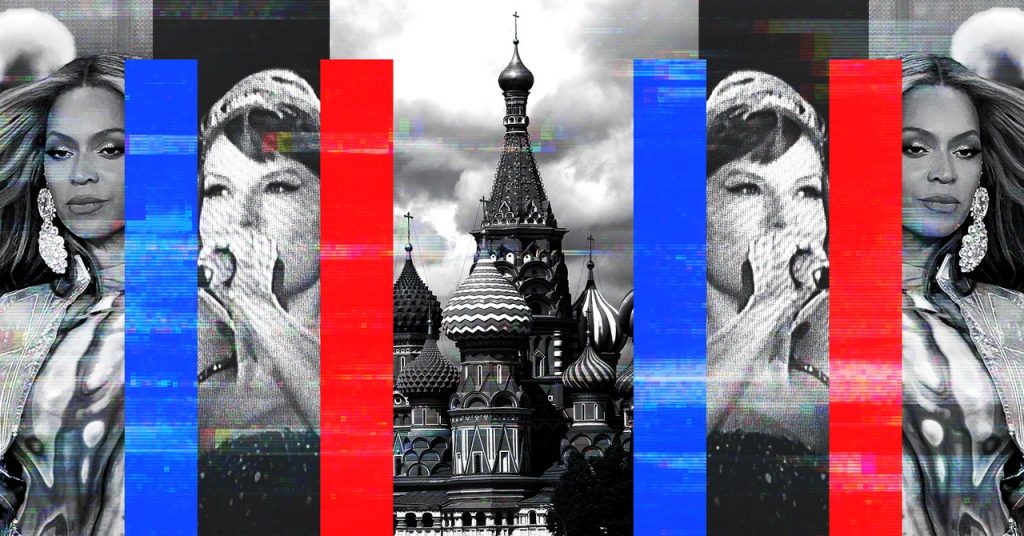

قال أحد الباحثين في Antibot4Navalny لـ WIRED: “لقد جمعنا ما يزيد عن 75 اقتباسًا مزيفًا لمشاهير من الولايات المتحدة والاتحاد الأوروبي، تم نشرها جميعًا على نطاق واسع مؤخرًا بواسطة روبوتات Doppelganger، حملة التأثير المؤيدة للكرملين”.

واستخدمت الحملة على X، والتي تزامنت مع حملة فيسبوك، أكثر من 10000 حساب روبوت، وفقًا للباحثين. وفي غضون فترة ثماني ساعات، نشرت الروبوتات أكثر من 27000 رسالة. وفي مرحلة ما، كانت حسابات الروبوت تنشر 120 رسالة كل دقيقة.

تتطابق المنشورات الموجودة على X مع تلك المنشورة كإعلانات على فيسبوك والتي تم تحديدها بواسطة Reset، باستثناء أن بعض هذه المنشورات كانت باللغة الإنجليزية. تضمنت حملة X أيضًا نسخًا وهمية من حسابات المشاهير التي تم التحقق منها على Instagram، مما جعل الأمر يبدو كما لو أنه تمت مشاركة لقطات شاشة لحسابات المشاهير على Instagram، باستخدام اقتباسات مماثلة مناهضة لأوكرانيا.

لم يستجب X لطلب التعليق من WIRED حول حملة Doppelganger. منذ أن سيطر إيلون ماسك على المنصة في أكتوبر 2022، قام بتصفية معظم فريق الثقة والسلامة في الشركة، وازدهرت المعلومات المضللة على الموقع، خاصة حول الأحداث الإخبارية العاجلة مثل الحرب الأخيرة بين إسرائيل وحماس.

أحد الباحثين في Reset، الذي لم يرغب في الكشف عن هويته لحماية هويته من الهجمات الانتقامية، أخبر WIRED أنه في الأيام الأخيرة، شهد الباحثون تطور حملة Doppelganger القائمة على المشاهير. تتميز بعض الإعلانات على فيسبوك الآن، مثل تلك الموجودة على X، بلقطات شاشة تظهر وكأنها تُظهر حسابات Instagram التي تم التحقق منها لنفس المشاهير، مما يضيف طبقة أخرى من الأصالة إلى الحملة. في إحدى الحالات، تشير لقطة شاشة لمنشور مزيف على إنستغرام من رجل الأعمال ريتشارد برانسون إلى أنه يعتقد أن أمريكا كانت وراء انفجار نورد ستريم.

ووجد الباحثون أيضًا إعلانات فيديو تحتوي على لقطات حقيقية لمشاهير مع صوت مزيف مدبلج في الأعلى، والتي يقولون إنها تم إنشاؤها باستخدام تطبيقات تحويل النص إلى كلام. لم يتمكن الباحثون في Reset من تحديد التطبيق الذي تم استخدامه لأتمتة إنشاء مقاطع الفيديو. أحد الأمثلة التي استعرضتها WIRED أظهرت لقطات للمخرج الألماني فيم فيندرز يتحدث باللغة الإنجليزية عن أفلامه، مدبلجًا لجعله يبدو كما لو كان يتحدث باللغة الفرنسية حول كيفية “تدمير الأوكرانيين”. تم نشر الإعلان على فيسبوك في 25 تشرين الثاني (نوفمبر) وشاهده ما يصل إلى 3000 شخص قبل إزالته لعدم حصوله على “إخلاء المسؤولية المطلوب”، وفقًا لمكتبة إعلانات فيسبوك.